「人類のためのAIを作る」と宣言してきた2社が、軍との関係をめぐって正反対の結末を迎えました。

2026年2月27日、米国防総省(通称:ペンタゴン)との契約交渉が決裂したAnthropicは、トランプ大統領の命令によって全連邦機関からの使用を禁じられ、国防総省から「サプライチェーンリスク(供給網上のリスク)」に指定されました。

同じ日の数時間後、OpenAIが国防総省との新たな契約締結を発表しました。

この1週間の出来事は、AIの倫理と国家安全保障が激しく衝突した歴史的な事件として、業界に深い爪痕を残しています。

「どちらが正しかったのか」という問いに、簡単な答えはありません。

しかし、2社の選択の背景にある思想の違い、そして今後のAI利用に対する影響を理解することは、私たちユーザーにとって不可欠なことです。

この記事では、交渉の経緯、契約内容の違い、そして今後のAI倫理への影響について、できる限り誠実に整理してお伝えします。

そもそもAnthropicとペンタゴンの関係とは?

Anthropicは2021年に、OpenAIの元研究者たちが「AIの安全性」を最優先に掲げて創業した会社です。

「安全なAIの開発」を企業理念の中心に置いており、Claudeはその理念を体現するモデルとして開発されてきました。

しかし実態は、いわゆる「反軍事企業」ではありませんでした。

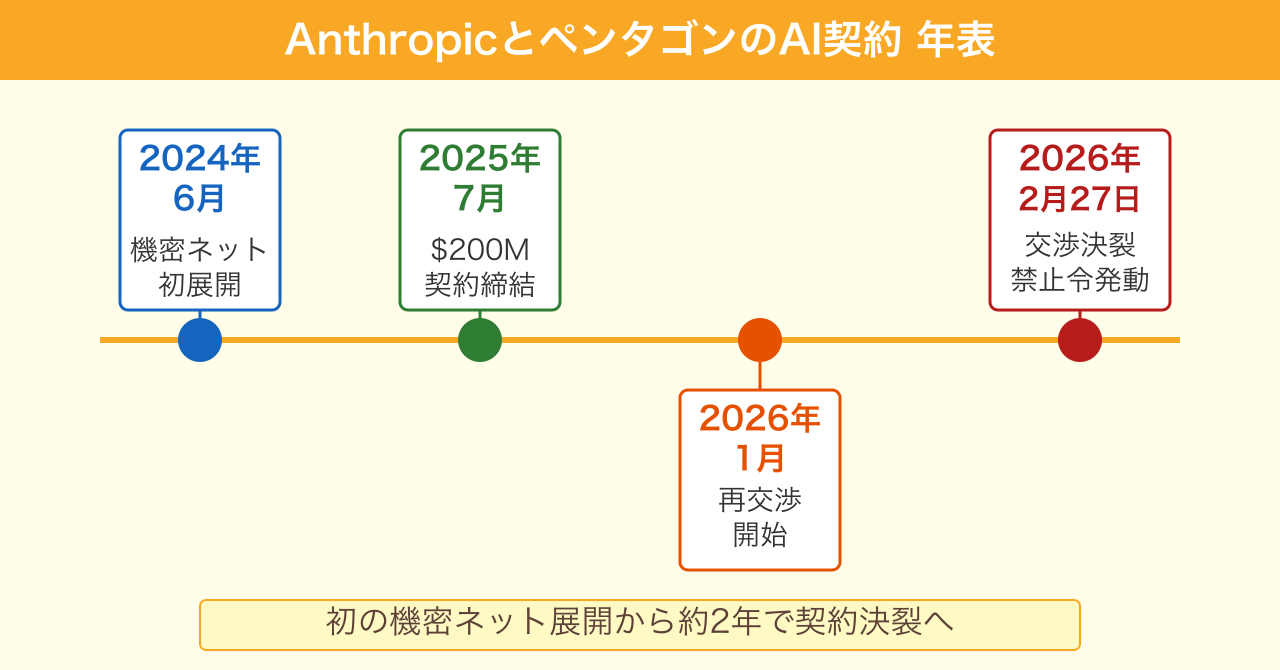

Anthropicはむしろ、主要AIラボの中で最も早く、2024年6月の時点で米国政府の機密ネットワーク上にClaudeを展開した企業でした。

2025年7月には国防総省と最大2億ドル(約300億円)の契約を締結し、国防分野で広く使われていました。

当初の契約には、Claudeを「米国市民の大規模監視」と「完全自律型兵器の制御」に使用することを禁じる条項が明記されており、国防総省はこの条件を受け入れていました。

問題は、2026年1月にヘゲス国防長官が全国防省AI契約を「合法的なすべての目的」に使えるよう改訂する方針を示したことから始まります。

(参照:Axios)

決裂までの1週間──何が起きたのか

2026年2月下旬、Anthropicと国防総省の交渉は最終局面に入りました。

ペンタゴンが求めたのは、Claudeを「すべての合法的な目的に制限なく使える」という文言の追加でした。

Anthropicが拒否したのは、この中に含まれうる2つの具体的な用途でした。

1つ目:米国市民の大規模監視

AIを活用すれば、位置情報・ウェブ閲覧履歴・金融データなどを大規模かつ自動的に集積・分析できます。

Anthropicは、これが令状なしの監視に悪用される可能性を懸念していました。

2つ目:完全自律型兵器の制御

人間が介在せずAIが自律的にターゲットを選定・攻撃する兵器システムへの利用です。

Anthropicは「現在のフロンティアAIはこの用途に使うには信頼性が不十分」として拒否しました。

(参照:NPR)

2月25日、Dario Amodei(ダリオ・アモダイ)CEOはヘゲス国防長官と直接会談しました。

会談後もペンタゴンは最終期限を「2月27日午後5時01分」と設定し、Anthropicに要求への合意を迫りました。

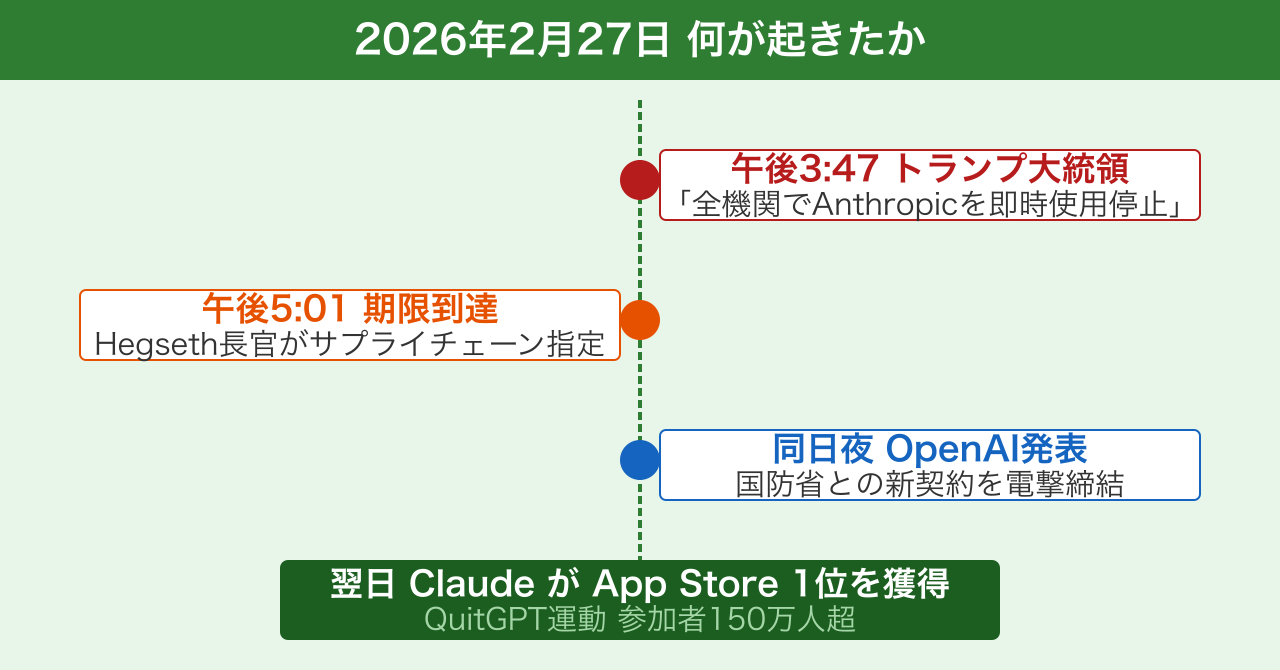

2月27日午後3時47分、Anthropicが期限を迎える前に、トランプ大統領がTruth Socialに「すべての連邦機関はAnthropicの技術を直ちに使用停止せよ」と投稿しました。

さらにヘゲス長官は、Anthropicを「国家安全保障上のサプライチェーンリスク」に指定すると宣言しました。

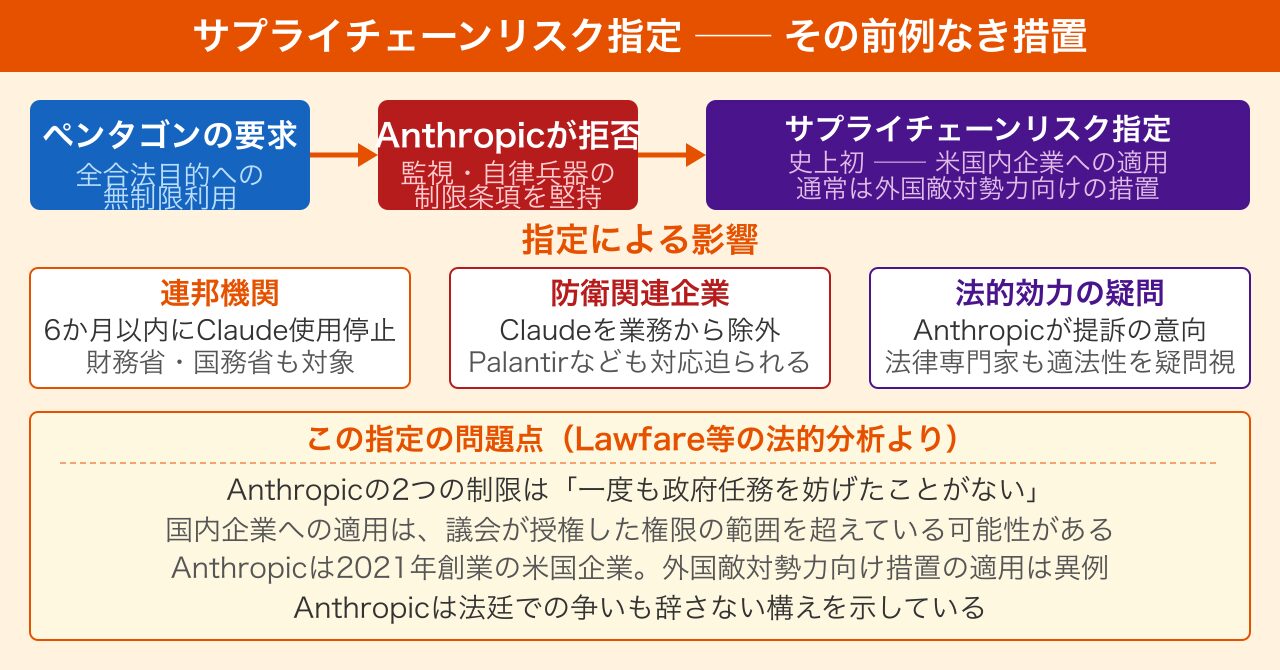

この指定は通常、中国のHuaweiなど外国の敵対勢力に対して用いられる措置です。

アメリカ国内の企業に適用されたのは、史上初めてのことでした。

(参照:Axios)

Amodei CEOは声明の中でこう述べました。

「私たちは誠実に合意に達しようとしました。しかし、良心に従えば彼らの要求には応じられません」

ペンタゴンからの脅しが私たちの立場を変えることはありません──。

そして、その数時間後、ライバルのOpenAIが国防総省との新契約を発表しました。

OpenAIは「裏切り者」なのか──契約内容を徹底比較

OpenAIのSam Altman(サム・アルトマン)CEOは、2月27日の朝の時点で、Anthropicと同じレッドライン(越えてはならない一線)を持っていると公言していました。

ところが同日の夜、OpenAIは国防総省との契約締結を発表しました。

この一連の流れは、AI業界と一般ユーザーに大きな衝撃を与えました。

Claudeは翌日、米国App Storeで1位を獲得しました。

「QuitGPT」運動では150万人以上がChatGPT解約の意思を示し、OpenAIのオフィス前には「あなたのレッドラインはどこにあるの?」と記したメッセージが書かれました。

(参照:TechCrunch)

では実際に、OpenAIの契約とAnthropicが求めていた条件は何が違ったのでしょうか。

以下の表に整理しました。

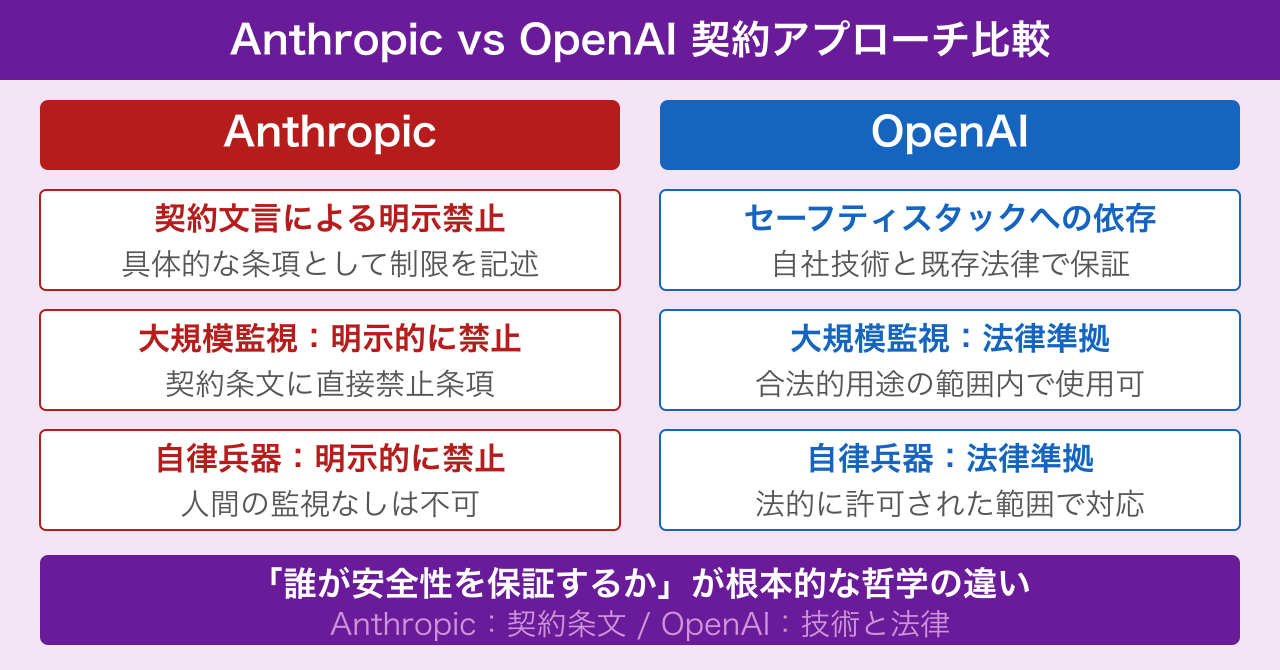

OpenAIの契約には、表面上は3つのレッドラインが含まれています。

① 米国市民の大規模監視には使用しない

② 完全自律型兵器システムの誘導には使用しない

③ 人間の承認を要する高リスクな意思決定には使用しない

これはAnthropicの主張と実質的に同じように見えます。

しかし批評家が指摘するのは、OpenAIの契約が「米国の法律に準拠したすべての目的」を許容しており、その法解釈を国防総省自身が行う点です。

MITテクノロジーレビューは「Anthropicは道義的なアプローチを取り、多くの支持者を得たが失敗した。OpenAIは実用的・法的なアプローチを取り、ペンタゴンに対してより軟化している」と指摘しています。

契約の大きな違いは「誰が運用の安全性を保証するか」にあります。

Anthropicは契約文言による明示的な禁止事項を求めました。

OpenAIは自社のセーフティスタック(安全管理技術) と既存の法律への依存を選びました。

これは根本的な哲学の違いです。

「法律が許すならAIを使っていい」という立場と、「たとえ法的には問題なくても、AIが倫理的に問題のある用途に使われるべきでない」という立場の対立です。

(参照:OpenAI)

さらに、Altman CEO自身も後に「急ぎすぎた」と認めました。

「私たちは状況を収拾しようとしたが、それは機会主義的で杜撰に見えた」

この発言の翌日、OpenAI社内でも社員の間に不満が広がっていることが報じられました。

「Anthropicが立場を貫いたことを尊重している。OpenAIのやり方に失望している」と匿名で語った社員もいました。

(参照:CNN)

サプライチェーンリスク指定の法的問題

「サプライチェーンリスク」指定は、連邦調達供給チェーン安全法(FASCSA)に基づく措置です。

これは通常、外国の敵対勢力、たとえば中国のHuaweiやZTEのような企業を対象とするものです。

Anthropicはアメリカ国内の企業です。シンガポール、UAE、カタールの政府系ファンドなどが出資者に含まれますが、これは多くのシリコンバレー企業と変わりません。

Lawfare(法律・安全保障専門メディア)の分析によれば、ヘゲス長官の指定は「議会が授権した権限の範囲を超えており、法廷で生き残る可能性は低い」と評しています。

また、「Anthropicの2つの制限が、実際に政府の任務に影響を与えたことは一度もない」という事実も、指定の法的根拠を弱める要素とされています。

(参照:Lawfare)

Anthropic側の反論も注目されています。

Amodei CEOは「この指定は法的に根拠がない。裁判所で争う以外に選択肢はない」と述べました。

また指定の実際の影響範囲についても、ヘゲス長官の発言より狭いことが明らかになっています。

マイクロソフト、Google、Amazonはそれぞれ「国防省関連以外の業務ではAnthropicとの関係を継続できる」と表明しました。

(参照:CNN Business)

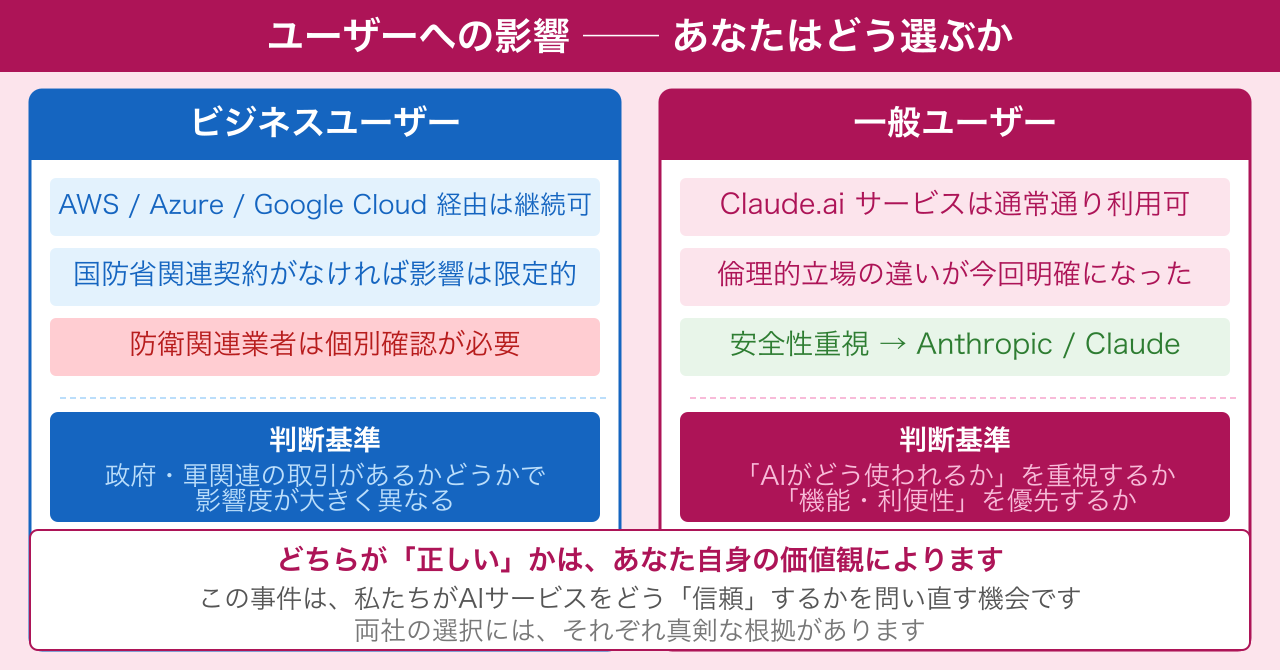

ユーザーへの影響──今後のAI選択をどう考えるか

この事件は、私たちがAIサービスを選ぶ際の判断基準を根本から問い直します。

ビジネスユーザーの方へ

国防省との関係に直接関係しない企業ユーザーであれば、Anthropic製品への影響は限定的です。

AWS、Google Cloud、Azureなどのプラットフォーム経由でのClaude利用は継続できます。

ただし、米国政府機関や防衛関連の契約を持つ企業は、サプライチェーンリスク指定の影響を個別に確認する必要があります。

一般ユーザーの方へ

この事件でClaude(Anthropic)とChatGPT(OpenAI)の「倫理的な立場」の違いが鮮明になりました。

どちらが「正しい」かは、あなた自身の価値観によります。

「国家安全保障に協力することが重要」と考えるなら、OpenAIの実用主義的アプローチを評価するかもしれません。

「AIがどんな目的に使われるか、そのルールを企業が守るべき」と考えるなら、Anthropicの姿勢に共感するかもしれません。

どちらの立場も、それぞれに真剣な根拠を持っています。

(参照:Built In)

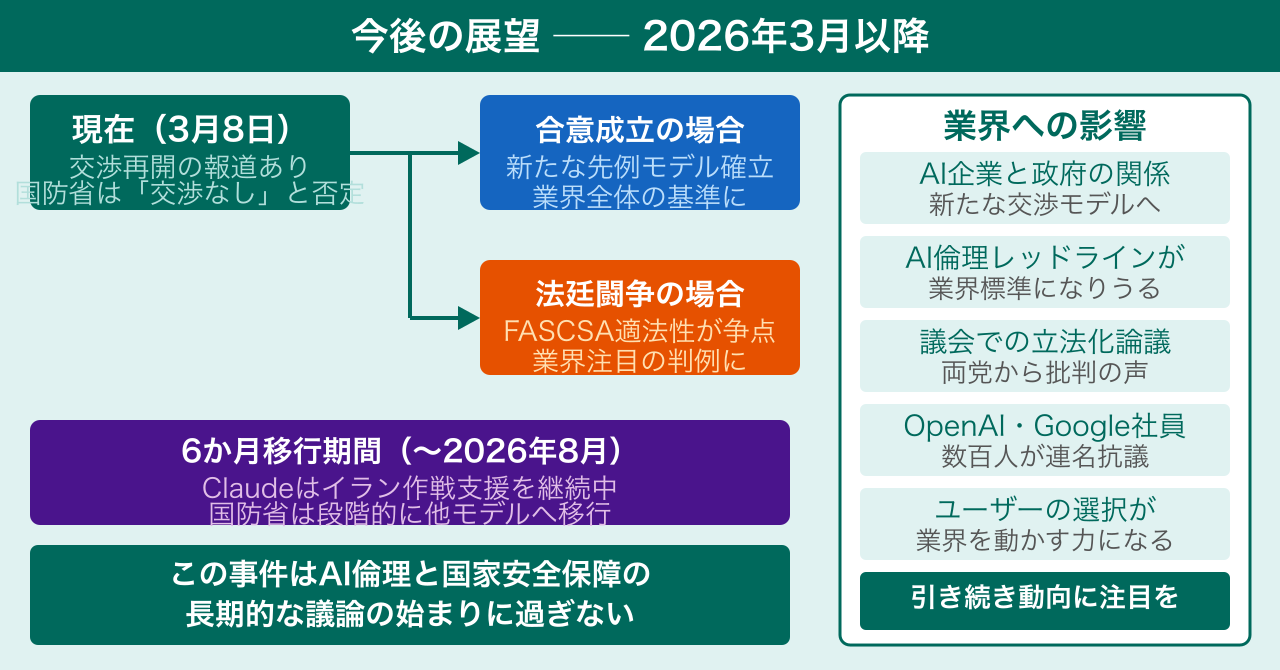

今後の展望──交渉は続いているか

2026年3月8日現在、状況は流動的です。

フィナンシャル・タイムズは、Anthropicとペンタゴンが再び交渉のテーブルについていると報じました。

Amodei CEOが国防次官のEmil Michael氏と直接対話を続けているとされますが、国防総省側は「現在交渉は存在しない」と否定しています。

ペンタゴンは引き続きClaudeをイランへの軍事作戦支援に使用しており、6か月の移行期間が設けられています。

OpenAI社内でも批判の声は続いており、OpenAIとGoogle両社の社員数百人が連名で「国防省のAnthropicに対する指定を撤回せよ」とする声明を発表しています。

共和党のThom Tillis上院議員は「この公開対立は子供じみている」と批判し、民主党のKirsten Gillibrand議員は「この指定は近視眼的で自滅的、敵国への贈り物だ」と述べました。

(参照:CNBC)

「AIの倫理」と「国家安全保障」の対立は、この事件で決着がついたわけではありません。

むしろ、ここから本格的な議論が始まったといえます。

Anthropicが守ろうとした「2つのレッドライン」は、今後すべてのAI企業と政府の関係において、重要な先例となるでしょう。

私たちユーザーも、AIをどう「信頼」するかを、改めて考え直す機会を与えられています。

今後の動向を引き続き注目していきましょう。

参照先

- Reuters ──── 米国情報機関のAI活用状況

- Axios(2月15日) ──── ペンタゴンとAnthropicの緊張

- Axios(2月27日) ──── Anthropicのサプライチェーンリスク指定

- NPR ──── トランプ政権のAnthropicへの禁止令

- OpenAI公式 ──── OpenAIとペンタゴンの契約内容

- TechCrunch ──── OpenAI契約の詳細

- MIT Technology Review ──── OpenAIの妥協とAnthropicの懸念

- CNN Business(3月4日) ──── OpenAI社員の反応

- CNN Business(3月5日) ──── サプライチェーンリスク指定の範囲

- CNBC ──── Anthropicとペンタゴンの再交渉

- Lawfare ──── 法的分析

- Built In ──── OpenAI契約の内容比較

- Fortune ──── Amodei CEOの謝罪と声明

コメント